Autor: Marcelo Tibau

Edição: Sean Siqueira, Mariano Pimentel, Renata Araujo e Tadeu Moreira de Classe.

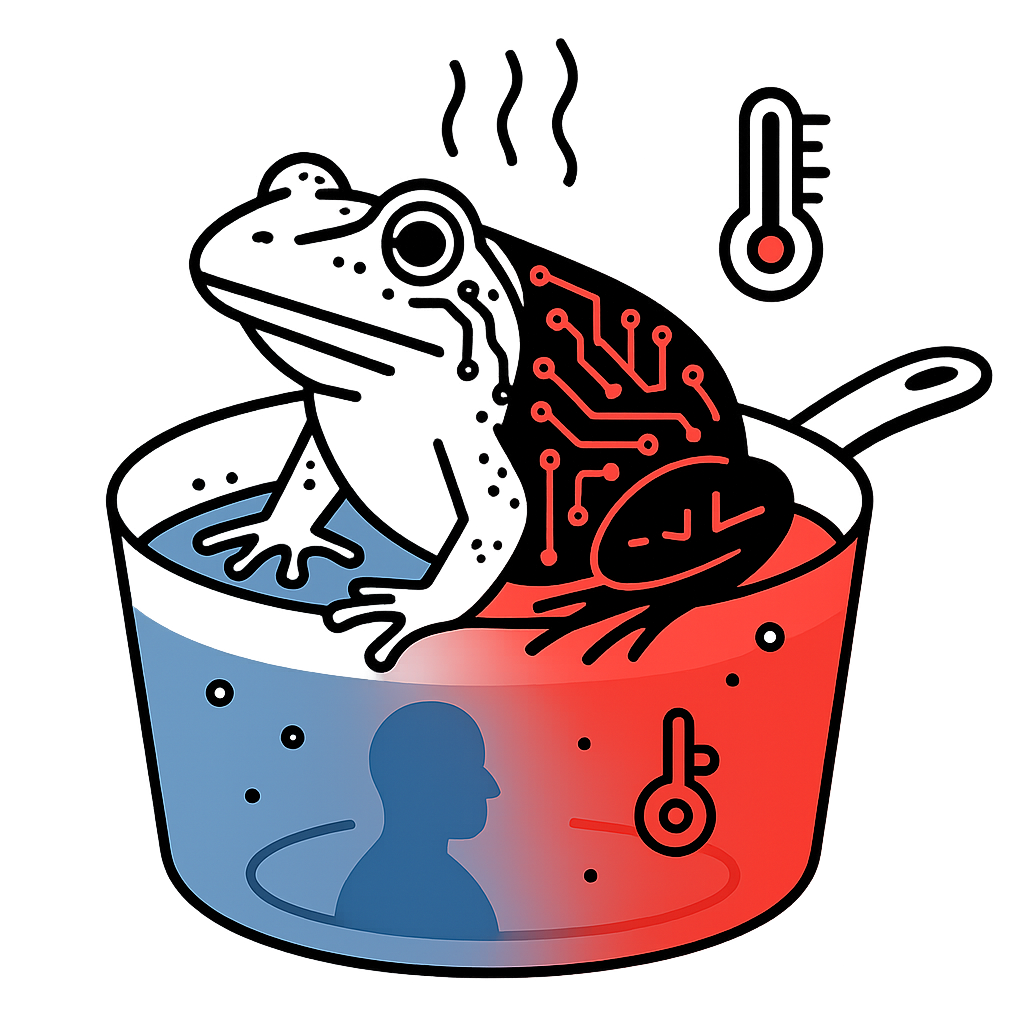

Ninguém nota quando a água começa a ferver. O sapo, tranquilo, continua imóvel na panela enquanto a temperatura sobe devagar, agradável, até demais. Só quando já é tarde, o nosso amigo anfíbio percebe que perdeu a chance de saltar e se salvar. Nossa relação com as Inteligências Artificiais (IAs), em especial com os chatbots, segue o mesmo padrão. As mudanças são sutis, uma resposta que parece mais segura ali, um tom mais empático ou um conselho mais convincente aqui. De forma quase imperceptível, a água esquenta. O que antes era apenas uma ferramenta começa a ocupar o espaço de uma autoridade e o salto epistêmico que separa informação de conhecimento se dissolve na temperatura morna da conveniência.

A filósofa Susan Schneider chama isso de “problema do sapo cozido” (Schneider, 2025), caracterizado pela combinação de fatores como confiança excessiva, opacidade dos modelos, manipulação emocional e perda gradual de autonomia epistêmica, criando um cenário em que a dependência dos chatbots cresce sem que percebamos (Figura 1).

Figura 1: O “problema do sapo cozido” na era dos chatbots, em que a confiança crescente transforma ferramentas em autoridades epistêmicas.

Leia o texto completo na Revista Horizontes da SBC (Sociedade Brasileira de Computação).